Τα βαθιά νευρωνικά δίκτυα (DNN), οι αλγόριθμοι μηχανικής μάθησης που υποστηρίζουν τη λειτουργία μεγάλων γλωσσικών μοντέλων (LLM) και άλλων μοντέλων τεχνητής νοημοσύνης (AI), μαθαίνουν να κάνουν ακριβείς προβλέψεις αναλύοντας μεγάλες ποσότητες δεδομένων. Αυτά τα δίκτυα είναι δομημένα σε επίπεδα, καθένα από τα οποία μετατρέπει τα δεδομένα εισόδου σε «χαρακτηριστικά» που καθοδηγούν την ανάλυση του επόμενου επιπέδου.

Τρόποι μάθησης

Η διαδικασία μέσω της οποίας τα DNN μαθαίνουν χαρακτηριστικά έχει αποτελέσει αντικείμενο πολυάριθμων ερευνητικών μελετών και είναι τελικά το κλειδί για την καλή απόδοση αυτών των μοντέλων σε μια ποικιλία εργασιών. Πρόσφατα, ορισμένοι επιστήμονες υπολογιστών έχουν αρχίσει να διερευνούν τη δυνατότητα μοντελοποίησης της μάθησης χαρακτηριστικών σε DNN χρησιμοποιώντας πλαίσια και προσεγγίσεις που βασίζονται στη φυσική.

Ερευνητές στο Πανεπιστήμιο της Βασιλείας και στο Πανεπιστήμιο Επιστήμης και Τεχνολογίας της Κίνας ανακάλυψαν ένα διάγραμμα φάσεων ένα γράφημα που μοιάζει με αυτά που χρησιμοποιούνται στη θερμοδυναμική για την οριοθέτηση των υγρών, αέριων και στερεών φάσεων του νερού, το οποίο αναπαριστά τον τρόπο με τον οποίο τα DNN μαθαίνουν χαρακτηριστικά υπό διάφορες συνθήκες.

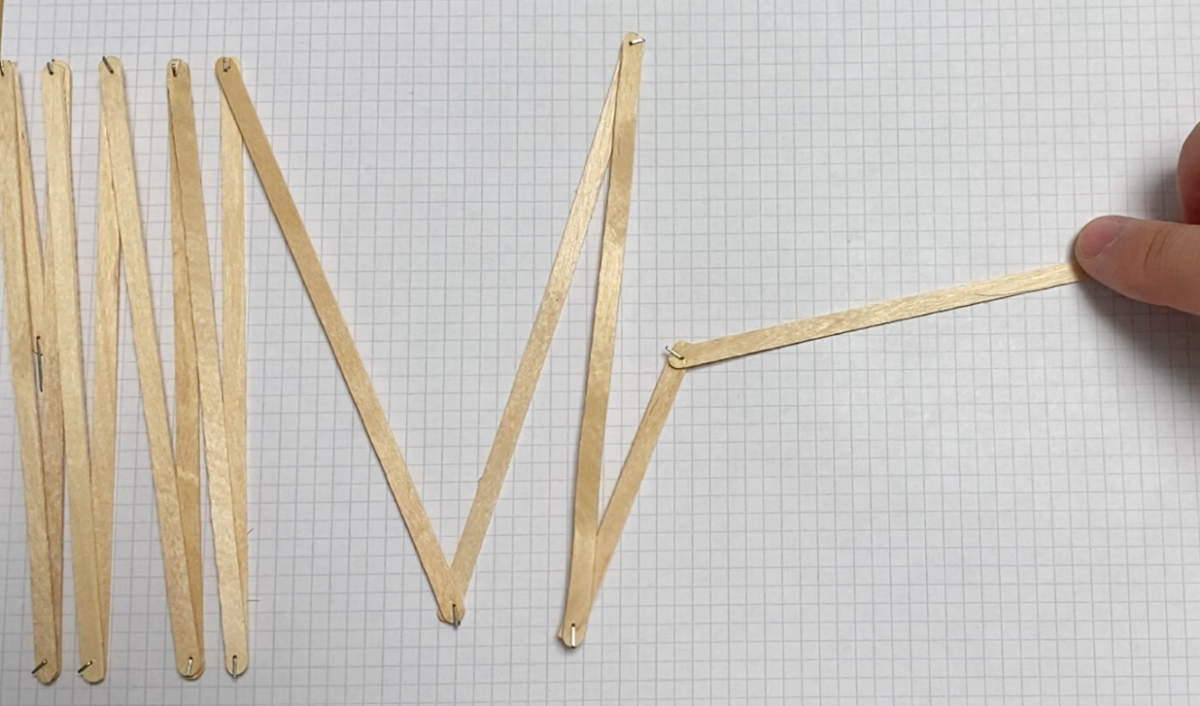

Η εργασία τους, που δημοσιεύτηκε στο Physical Review Letters , μοντελοποιεί ένα DNN ως αλυσίδα ελατηρίου-μπλοκ, ένα απλό μηχανικό σύστημα που χρησιμοποιείται συχνά για τη μελέτη αλληλεπιδράσεων μεταξύ γραμμικών (ελατήριο) και μη γραμμικών (τριβή) δυνάμεων.

«Ο Τσενγκ και εγώ ήμασταν σε ένα εργαστήριο όπου έγινε μια εμπνευσμένη ομιλία με θέμα «έναν νόμο διαχωρισμού δεδομένων»», δήλωσε στο Phys.org ο Ιβάν Ντόκμανιτς, ερευνητής που ηγήθηκε της μελέτης. «Τα στρώματα ενός βαθύ νευρωνικού δικτύου (αλλά και βιολογικών νευρωνικών δικτύων όπως ο ανθρώπινος οπτικός φλοιός) επεξεργάζονται τα δεδομένα εισόδου με προοδευτική απόσταξη και απλοποίησή τους.

«Όσο πιο βαθιά βρίσκεστε στο δίκτυο, τόσο πιο κανονικές, πιο γεωμετρικές γίνονται αυτές οι αναπαραστάσεις, πράγμα που σημαίνει ότι οι αναπαραστάσεις διαφορετικών κατηγοριών αντικειμένων (π.χ., αναπαραστάσεις γατών και σκύλων) γίνονται πιο ξεχωριστές και πιο εύκολο να διακριθούν. Υπάρχει ένας τρόπος να μετρηθεί αυτός ο διαχωρισμός.»

«Η ομιλία έδειξε ότι σε καλά εκπαιδευμένα νευρωνικά δίκτυα συμβαίνει συχνά αυτά τα «συνοπτικά στατιστικά στοιχεία» διαχωρισμού δεδομένων να συμπεριφέρονται με απλό τρόπο, ακόμη και για πολύ περίπλοκα βαθιά νευρωνικά δίκτυα που έχουν εκπαιδευτεί σε περίπλοκα δεδομένα: κάθε επίπεδο βελτιώνει τον διαχωρισμό κατά το ίδιο ποσοστό.»

«Νόμος του διαχωρισμού δεδομένων»

Η ομάδα διαπίστωσε ότι ο «νόμος του διαχωρισμού δεδομένων» ίσχυε σε δίκτυα με κοινώς χρησιμοποιούμενες «υπερπαραμέτρους», όπως ο ρυθμός εκμάθησης και ο θόρυβος, αλλά όχι για διαφορετικές επιλογές υπερπαραμέτρων. Συνειδητοποίησαν ότι η κατανόηση του γιατί συμβαίνει αυτό θα μπορούσε να ρίξει φως στο πώς τα DNN μαθαίνουν καλά χαρακτηριστικά σε όλα τα μοντέλα. Έτσι, ξεκίνησαν να βρουν μια κατάλληλη θεωρητική περιγραφή αυτών των ενδιαφέρουσων ευρημάτων.

«Ταυτόχρονα, συμμετείχαμε σε ορισμένα έργα γεωφυσικής όπου οι άνθρωποι χρησιμοποιούν μοντέλα ελατηρίων ως φαινομενολογικά μοντέλα δυναμικής ρηγμάτων και σεισμών», δήλωσε ο Dokmanić.

«Η φαινομενολογία διαχωρισμού δεδομένων μας το θύμισε αυτό. Σκεφτήκαμε πολλές άλλες αναλογίες. Για παράδειγμα, ο Cheng σκέφτηκε ότι ο ίσος διαχωρισμός δεδομένων είναι λίγο σαν μια αναδιπλούμενη κρεμάστρα ρούχων.

«Περάσαμε εκείνες τις χειμερινές διακοπές ανταλλάσσοντας φωτογραφίες και βίντεο από διάφορα οικιακά αντικείμενα και εργαλεία με «στρωματική δομή», όπως αυτές οι κρεμάστρες, οι πτυσσόμενοι χάρακες κ.λπ. Θυμάμαι να συζητάω για το αν ένα συγκεκριμένο ελαστικό τρίποδο είναι ένα καλό μοντέλο για ένα διάσημο βαθύ νευρωνικό δίκτυο που ονομάζεται ResNet.»

Περισσότερες πληροφορίες: Cheng Shi et al, Θεωρία Spring-Block της Μάθησης Χαρακτηριστικών σε Βαθιά Νευρωνικά Δίκτυα, Physical Review Letters (2025). DOI: 10.1103/ys4n-2tj3 .

Πληροφορίες περιοδικού: Επιστολές Φυσικής Ανασκόπησης