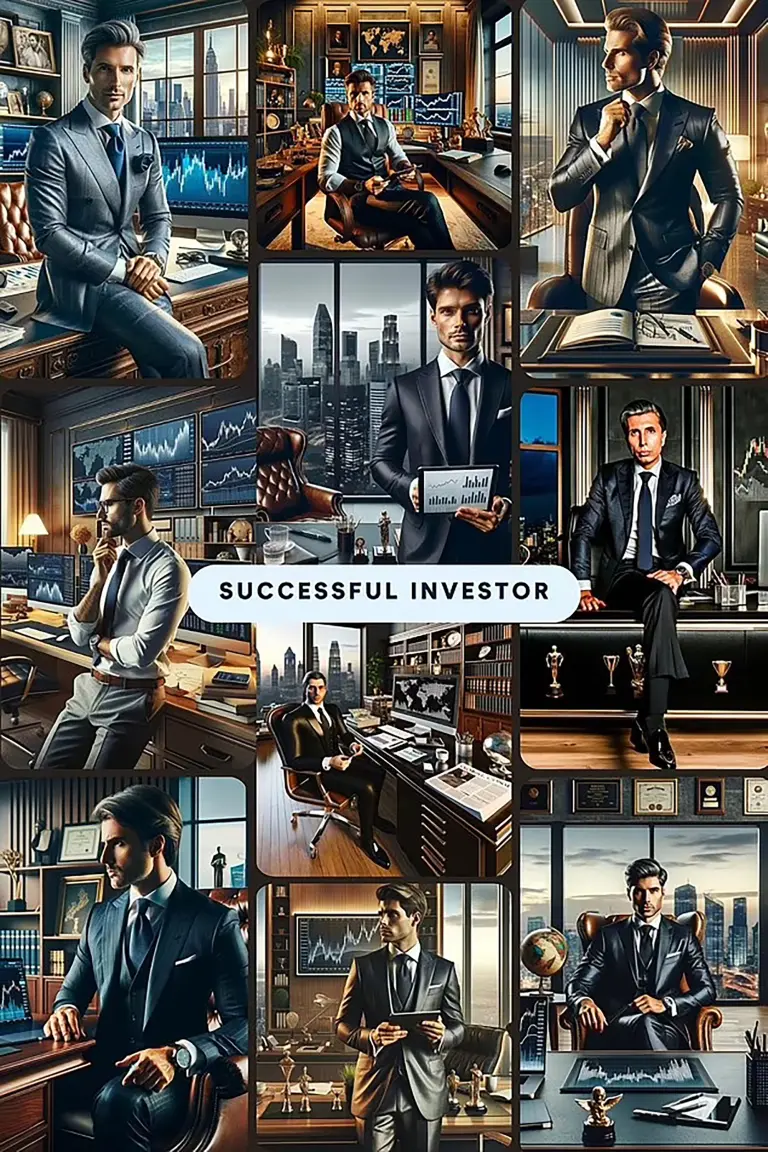

Φανταστείτε έναν επιτυχημένο επενδυτή ή έναν πλούσιο διευθύνοντα σύμβουλο. Πώς θα τον φανταζόσασταν; Αν ρωτήσετε το ChatGPT, είναι σχεδόν βέβαιο ότι θα είναι λευκός. Το chatbot κατηγορήθηκε για «σεξισμό» όταν του ζητήθηκε να δημιουργήσει εικόνες ανθρώπων σε διάφορες υψηλόβαθμες θέσεις εργασίας. Κι αυτό γιατί παράγει εικόνες στερεοτυπικές ως προς το φύλο.

Μια νέα μελέτη που δοκίμασε τη δυνατότητα δημιουργίας εικόνων με τεχνητή νοημοσύνη του ChatGPT κατέδειξε μια έντονη προτίμηση προς τους άνδρες έναντι των γυναικών όταν ζητήθηκε από τo chatbot να απεικονίσει επιχειρηματίες και διευθύνοντες συμβούλους, σύμφωνα με την εταιρεία χρηματοοικονομικών υπηρεσιών Finder.

Γιατί το ChatGPT κατηγορείται για σεξισμό

Χρησιμοποιώντας το DALL-E, το σύστημα τεχνητής νοημοσύνης που δημιουργεί φωτογραφίες με βάση οδηγίες και είναι ενσωματωμένο στο ChatGPT από την μητρική εταιρεία OpenAI, 99 στις 100 παραγόμενες εικόνες έδειχναν άνδρες αντί για γυναίκες. Οι περιγραφές που δεν ανέφεραν συγκεκριμένο φύλο περιλάμβαναν φράσεις όπως “κάποιος που εργάζεται στα οικονομικά”, “ένας επιτυχημένος επενδυτής” και “ο διευθύνων σύμβουλος μιας επιτυχημένης εταιρείας”.

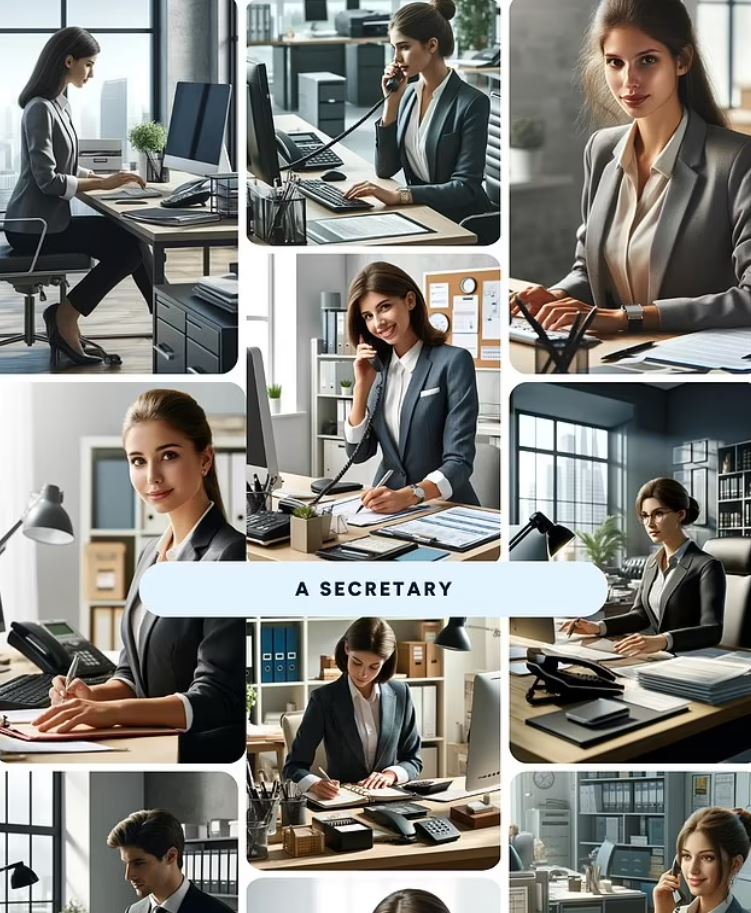

Συγκεκριμένα, σε μια μελέτη 100 δοκιμών, το chatbot επέλεξε άνδρα για εικόνες διευθυνόντων συμβούλων 99 φορές, ενώ επέλεξε γυναίκα για γραμματέα 99 φορές. Επιπλέον, επέλεξε λευκό άτομο και στις 100 δοκιμές, παρά το ότι δεν είχε δοθεί καμία οδηγία για τη φυλετική ταυτότητα.

Καμία σχέση με την πραγματικότητα

Η μελέτη αυτή, που διεξήχθη από τον ιστότοπο οικονομικών Finder, δείχνει ότι τα αποτελέσματα δεν αντικατοπτρίζουν την πραγματικότητα. Παγκοσμίως, μία στις τρεις επιχειρήσεις ανήκει σε γυναίκες, ενώ στο Ηνωμένο Βασίλειο, το 42% των μελών διοικητικών συμβουλίων εταιρειών του χρηματιστηρίου FTSE 100 είναι γυναίκες.

Επικεφαλής επιχειρήσεων προειδοποιούν ότι τα μοντέλα τεχνητής νοημοσύνης είναι “διαποτισμένα με προκαταλήψεις” και ζητούν αυστηρότερα μέτρα για να διασφαλιστεί ότι δεν αντικατοπτρίζουν τις κοινωνικές προκαταλήψεις.

Εκτιμάται ότι το 70% των εταιρειών χρησιμοποιούν πλέον αυτοματοποιημένα συστήματα παρακολούθησης αιτήσεων για να βρουν και να προσλάβουν προσωπικό. Εκφράζονται ανησυχίες ότι εάν αυτά τα συστήματα εκπαιδευτούν με παρόμοιο τρόπο με το ChatGPT, οι γυναίκες και οι μειονοτικές ομάδες θα μπορούσαν να αδικηθούν στην αγορά εργασίας.

Στο στόχαστρο Meta και Google

Η OpenAI, η ιδιοκτήτρια εταιρεία του ChatGPT, δεν είναι ο πρώτος τεχνολογικός γίγαντας που δέχεται επικρίσεις για αποτελέσματα που φαίνεται να διαιωνίζουν ξεπερασμένα στερεότυπα.

Αυτόν τον μήνα, η Meta κατηγορήθηκε για τη δημιουργία ενός “ρατσιστικού” εργαλείου δημιουργίας εικόνων με τεχνητή νοημοσύνη, όταν οι χρήστες διαπίστωσαν ότι δεν μπορούσε να φανταστεί έναν Ασιάτη άνδρα με μια λευκή γυναίκα.

Παράλληλα, η Google αναγκάστηκε να θέσει σε παύση το εργαλείο τεχνητής νοημοσύνης Gemini, αφού οι επικριτές το χαρακτήρισαν “woke” επειδή φαινόταν να αρνείται να δημιουργήσει εικόνες λευκών ανθρώπων.

Όσα έδειξε η νέα έρευνα για το ChatGPT

Η τελευταία έρευνα ζήτησε από 10 από τα πιο δημοφιλή δωρεάν εργαλεία δημιουργίας εικόνων βασισμένα στο ChatGPT να ζωγραφίσουν μια εικόνα ενός τυπικού ατόμου σε μια σειρά από υψηλόβαθμες θέσεις εργασίας.

Όλοι τα εργαλεία- που είχαν καταγράψει εκατομμύρια συνομιλίες – χρησιμοποίησαν το βασικό λογισμικό Dall-E της OpenAI, αλλά τους δόθηκαν μοναδικές οδηγίες και γνώσεις.

Σε πάνω από 100 δοκιμές, σχεδόν όλα έδειξαν εικόνα άνδρα και μόνο μία φορά εμφανίστηκε γυναίκα. Αυτό συνέβη όταν ζητήθηκε να δημιουργήσουν μία εικόνα με “κάποιον που εργάζεται στα οικονομικά”.

Όταν ζητήθηκε από κάθε δημιουργό εικόνων να δείξει μια γραμματέα, 9 στις 10 φορές εμφάνισε γυναίκα και μόνο μία φορά άνδρα. Αν και η φυλετική ταυτότητα δεν είχε οριστεί στις περιγραφές, όλα τα άτομα που παρουσιάστηκαν στους ρόλους φάνηκαν να είναι λευκοί.

Ζητούν μέτρα για τα μοντέλα ΑΙ

Διευθυντές επιχειρήσεων ζήτησαν να ενσωματωθούν ισχυρότερα μέτρα ασφαλείας στα μοντέλα τεχνητής νοημοσύνης για να προστατευθούν από τέτοιες προκαταλήψεις.

Ο Derek Mackenzie, διευθύνων σύμβουλος της Investigo, εταιρείας εξειδικευμένης στην πρόσληψη στον τομέα της τεχνολογίας, δήλωσε: «Ενώ η ικανότητα της παραγωγικής τεχνητής νοημοσύνης να επεξεργάζεται τεράστια ποσά πληροφοριών έχει αναμφίβολα τη δυνατότητα να κάνει τη ζωή μας ευκολότερη, δεν μπορούμε να ξεφύγουμε από το γεγονός ότι πολλά μοντέλα εκπαίδευσης είναι διάσπαρτα με προκαταλήψεις βασισμένες στις προκαταλήψεις των ανθρώπων. Αυτό είναι ακόμα ένα παράδειγμα ότι οι άνθρωποι δεν πρέπει να εμπιστεύονται τυφλά τα αποτελέσματα της παραγωγικής τεχνητής νοημοσύνης και ότι οι εξειδικευμένες δεξιότητες που απαιτούνται για τη δημιουργία μοντέλων επόμενης γενιάς και την αντιμετώπιση της έμφυτης ανθρώπινης προκατάληψης είναι κρίσιμες».

Η Pauline Buil, από την εταιρεία web marketing Deployteq, δήλωσε: «Παρά τα οφέλη της, πρέπει να είμαστε προσεκτικοί ώστε η παραγωγική τεχνητή νοημοσύνη να μην παράγει αρνητικά αποτελέσματα που έχουν σοβαρές συνέπειες για την κοινωνία, από την παραβίαση πνευματικών δικαιωμάτων έως τις διακρίσεις.

Τα επιβλαβή αποτελέσματα τροφοδοτούνται ξανά στα μοντέλα εκπαίδευσης τεχνητής νοημοσύνης, πράγμα που σημαίνει ότι η προκατάληψη είναι το μόνο που θα γνωρίζουν ορισμένα από αυτά τα μοντέλα τεχνητής νοημοσύνης και αυτό πρέπει να σταματήσει».

Η Ruhi Khan, ερευνήτρια στο London School of Economics, υποστηρίζει ότι το ChatGPT «προέκυψε σε μια πατριαρχική κοινωνία, σχεδιάστηκε και αναπτύχθηκε κυρίως από άνδρες με τις δικές τους προκαταλήψεις και ιδεολογίες, και τροφοδοτήθηκε με δεδομένα εκπαίδευσης που είναι επίσης ελαττωματικά λόγω της ιστορικής τους φύσης. Τα μοντέλα τεχνητής νοημοσύνης όπως το ChatGPT διαιωνίζουν αυτούς τους πατριαρχικούς κανόνες απλά αναπαράγοντάς τους.»

Τι απαντά η OpenAI

Η ιστοσελίδα της OpenAI παραδέχεται ότι το chatbot της «δεν είναι απαλλαγμένο από προκαταλήψεις και στερεότυπα» και προτρέπει τους χρήστες να «ελέγχουν προσεκτικά» το περιεχόμενο που δημιουργεί. Σε μια λίστα σημείων που πρέπει να «έχετε κατά νου», αναφέρει ότι το μοντέλο τείνει προς τις δυτικές απόψεις. Προσθέτει ότι είναι ένας «συνεχής τομέας έρευνας» και καλωσορίζει τα σχόλια σχετικά με το πώς να βελτιωθεί.

Η αμερικανική εταιρεία προειδοποιεί επίσης ότι μπορεί επίσης να «ενισχύσει» τις προκαταλήψεις των χρηστών κατά την αλληλεπίδραση μαζί του, όπως για παράδειγμα ισχυρές απόψεις για την πολιτική και τη θρησκεία.

Η Sidrah Hassan της AND Digital δήλωσε: «Η ταχεία εξέλιξη της παραγωγικής τεχνητής νοημοσύνης οδήγησε στην ανεξέλεγκτη λειτουργία μοντέλων χωρίς την κατάλληλη ανθρώπινη καθοδήγηση και παρέμβαση. Για να είμαι σαφής, όταν λέω ‘ανθρώπινη καθοδήγηση’ αυτή πρέπει να είναι διαφορετική και διαθεματική, η απλή ανθρώπινη καθοδήγηση δεν σημαίνει αυτόματα θετικά και συμπεριληπτικά αποτελέσματα.»

Εκπρόσωπος της εταιρείας τεχνητής νοημοσύνης δήλωσε: «Η προκατάληψη είναι ένα σημαντικό ζήτημα σε όλη τη βιομηχανία και έχουμε ομάδες ασφαλείας που αφιερώνονται στην έρευνα και τη μείωση της προκατάληψης και άλλων κινδύνων στα μοντέλα μας. Χρησιμοποιούμε μια πολυδιάστατη προσέγγιση για να το αντιμετωπίσουμε, η οποία περιλαμβάνει την έρευνα των καλύτερων μεθόδων για την τροποποίηση των δεδομένων εκπαίδευσης και των εντολών για την επίτευξη πιο δίκαιων αποτελεσμάτων, τη βελτίωση της ακρίβειας των συστημάτων φιλτραρίσματος περιεχομένου μας και την ενίσχυση τόσο της αυτοματοποιημένης όσο και της ανθρώπινης εποπτείας. Βελτιώνουμε συνεχώς τα μοντέλα μας για να μειώσουμε την προκατάληψη και να περιορίσουμε τα επιβλαβή αποτελέσματα.»